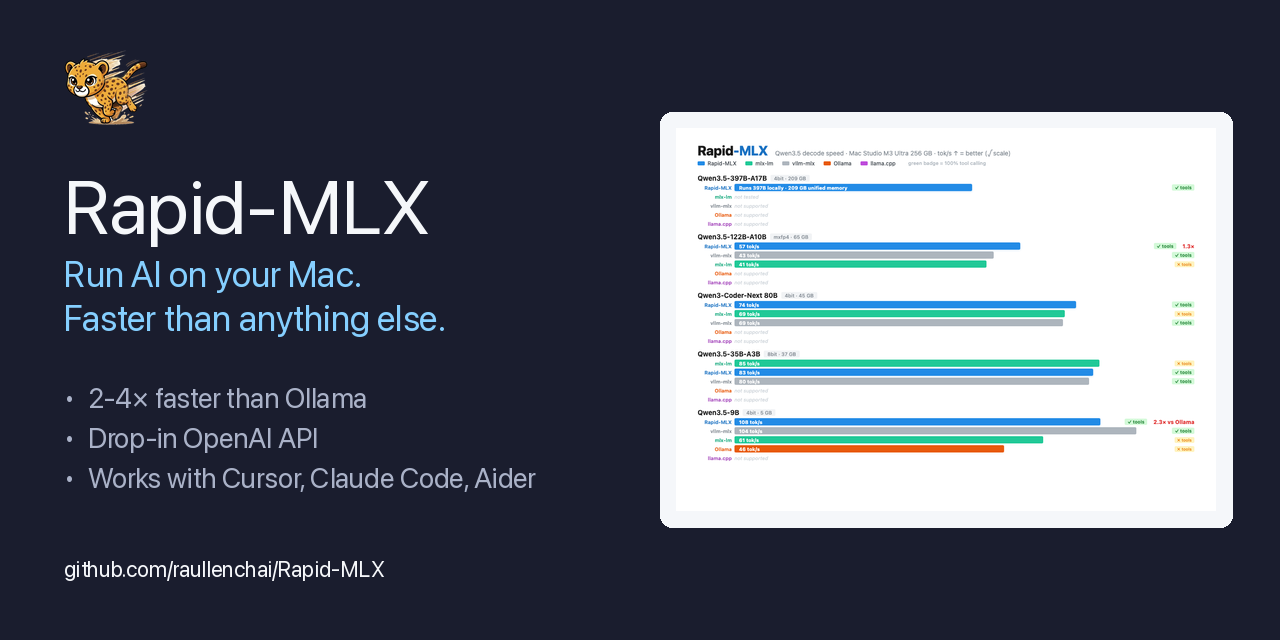

如果你用 M 系列 Mac,又想把本地模型接到 Claude Code、Cursor、Aider 或自己的工具里,Rapid-MLX 值得关注。

项目地址和用途

项目地址:https://github.com/raullenchai/Rapid-MLX。它面向本地推理场景。

- OpenAI 兼容接口

- 面向 Apple Silicon 优化

- 支持工具调用、提示缓存等开发者功能

- 适合本地测试和隐私敏感场景

新手上手建议

安装命令和支持模型建议以 GitHub README 为准。接入前先确认本机芯片、内存和模型大小是否匹配。

BASE_URL=http://localhost:端口/v1

API_KEY=本地服务要求的 key 或占位值

MODEL=你加载的本地模型名称配置好后,可以先用一个简单 chat completion 请求验证,再接入编辑器或 Agent 工具。

注意事项

本地模型体验很依赖硬件和模型选择。建议用自己的真实提示词测试速度、工具调用稳定性和上下文长度。

来源

© 版权声明

THE END

暂无评论内容