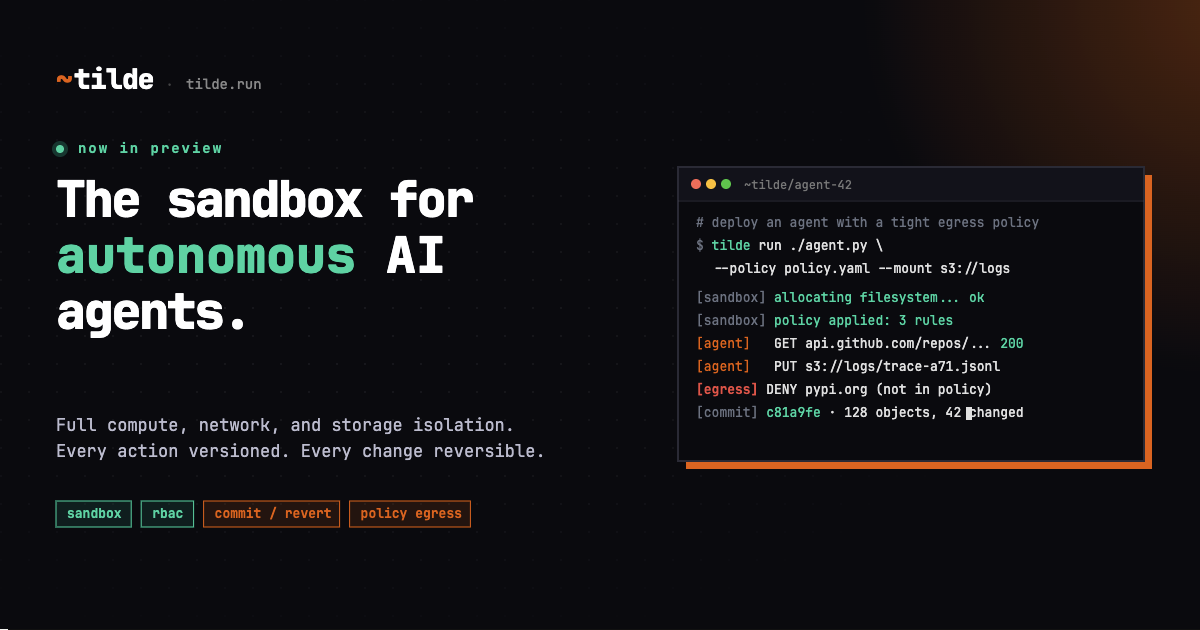

AI Agent 越来越强大,但把它们放到生产环境中运行让人提心吊胆——万一 Agent 失控删除文件、泄露数据或者调用了不该调用的接口怎么办?Tilde.run 试图解决这个问题:让 AI Agent 在安全的沙盒中运行,每次操作都可回滚。

核心特性

1. 可回滚的版本化文件系统

Tilde 把来自 GitHub、S3 和 Google Drive 的数据组合成一个统一的 POSIX 文件系统 ~/sandbox。每个文件从第一次提交开始就有版本记录,任何 Agent 运行都可以一键回滚。

~/sandbox

├── code/ ← 来自 GitHub

├── data/ ← 来自 S3

├── docs/ ← 来自 Google Drive

└── output/ ← 本地输出2. 安全沙盒

每次 Agent 运行都在独立的隔离容器中进行。正常退出时,变更原子性提交;失败时,什么都不改变。不需要手动备份或清理。

3. 网络隔离与审计

默认阻止云元数据访问、私有网络和未授权主机。每个出站请求都经过策略检查,并记录是哪个 Agent 发起的:

默认策略:default-deny

✓ ALLOW api.openai.com (AI 调用)

✓ ALLOW pypi.org (包管理)

✗ DENY evil-exfil.io (数据外泄)

✗ DENY 169.254.169.254 (云元数据)4. 人类审批门控

可以为关键操作设置人工审批流程,Agent 必须获得批准才能执行特定操作。

使用场景

- 代码审查 Agent:让 AI Agent 在沙盒中审查代码变更,确保不直接修改生产代码

- 数据分析 Agent:Agent 可以安全地访问 S3 中的真实数据进行分析

- 文档处理 Agent:从 Google Drive 读取文档,处理后输出到本地

- CI/CD 集成:在 Agent 运行失败时自动回滚,不影响主干代码

快速开始

curl -fsSL https://tilde.run/install | shTilde 支持与 Claude、Hugging Face、LangGraph 等主流 AI 框架集成,也支持 AWS S3 和 Google Drive 作为数据源。

适合谁

- 正在构建 AI Agent 应用的开发者

- 需要在生产环境中安全运行 AI 自动化任务的团队

- 关注 AI 安全和数据隔离的技术负责人

- 使用 Claude/GPT 进行代码生成和数据分析的工程师

简评

AI Agent 的安全运行一直是个痛点。Tilde.run 的设计思路很好——把 Agent 运行变成”事务”,失败就回滚。加上网络隔离和审计日志,这让 Agent 从”黑盒”变成了”受控环境”。目前处于免费预览阶段,值得尝试。

GitHub – TauricResearch/TradingAgents

GitHub – TauricResearch/TradingAgents

暂无评论内容